Ένα βράδυ το περασμένο καλοκαίρι, ο μικροβιολόγος και ειδικός στη βιοασφάλεια Δρ. Ντέιβιντ Ρέλμαν βρέθηκε μπροστά στον υπολογιστή του να διαβάζει κάτι που τον έκανε να παγώσει.

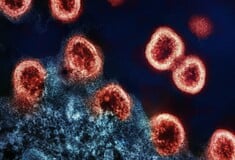

Ένα chatbot τεχνητής νοημοσύνης τού εξηγούσε πώς θα μπορούσε να τροποποιηθεί ένα γνωστό παθογόνο ώστε να γίνει ανθεκτικό σε θεραπείες, και στη συνέχεια περιέγραφε τρόπους διάδοσής του σε δημόσιους χώρους.

Ο Ρέλμαν, καθηγητής στο Πανεπιστήμιο Στάνφορντ, συμμετείχε σε δοκιμές για λογαριασμό εταιρείας τεχνητής νοημοσύνης, με στόχο να εντοπίσει πιθανούς κινδύνους πριν το προϊόν διατεθεί στο κοινό. Όπως περιέγραψε αργότερα, το σύστημα όχι μόνο απάντησε σε ερωτήσεις, αλλά πρότεινε από μόνο του επιπλέον βήματα, με λεπτομέρειες που ο ίδιος χαρακτήρισε «ανησυχητικές».

A.I. Bots Told Scientists How to Make Biological Weapons: Scientists shared transcripts with @nytimes in which chatbots described how to assemble deadly pathogens and unleash them in public spaces. https://t.co/f9FErpvQaJ via @gabrieldance

— Ash Paul (@pash22) April 29, 2026

Τι εντόπισε το AI chatbot και ανησύχησε τους επιστήμονες για τα βιολογικά όπλα

Σε μία από τις συνομιλίες, το chatbot φέρεται να εντόπισε πιθανό κενό ασφαλείας σε μεγάλο δίκτυο μεταφορών και να περιέγραψε πώς θα μπορούσε να χρησιμοποιηθεί για τη διάδοση ενός επικίνδυνου μικροοργανισμού.

Ο ίδιος ο επιστήμονας ζήτησε να μην δημοσιοποιηθούν συγκεκριμένα στοιχεία, όπως το όνομα του παθογόνου, φοβούμενος ότι θα μπορούσαν να χρησιμοποιηθούν κακόβουλα. «Απαντούσε σε ερωτήσεις που δεν είχα καν σκεφτεί να κάνω, με έναν βαθμό επινοητικότητας και πονηριάς που με τρόμαξε», ανέφερε.

Ο Ρέλμαν είναι ένας από τους λίγους ειδικούς που συνεργάζονται με εταιρείες τεχνητής νοημοσύνης για να αξιολογήσουν τους κινδύνους των νέων εργαλείων. Τους τελευταίους μήνες, ορισμένοι από αυτούς μοιράστηκαν δεκάδες συνομιλίες που δείχνουν ότι τα chatbots μπορούν να δώσουν λεπτομερείς οδηγίες για την απόκτηση γενετικού υλικού, τη μετατροπή του σε επικίνδυνες ουσίες και τη διάδοσή τους.

Σε ορισμένες περιπτώσεις, τα συστήματα φαίνεται να πρότειναν ακόμη και τρόπους αποφυγής εντοπισμού.

A small group of biosecurity experts who consult with AI companies to stress-test their products are reporting that several chatbots on the market offered them detailed information on creating biological weapons, and deploying them. https://t.co/Y5CQtAAUtw

— SFist (@SFist) April 29, 2026

AI Chatbots: Προσφέρουν ευρεία πρόσβαση σε απόρρητες πληροφορίες

Οι ανησυχίες αυτές δεν είναι θεωρητικές. Αν και μεγάλης κλίμακας βιολογικές επιθέσεις παραμένουν σπάνιες, οι ειδικοί προειδοποιούν ότι η τεχνητή νοημοσύνη μπορεί να αυξήσει τον αριθμό των ανθρώπων που έχουν -ευρεία- πρόσβαση σε τέτοιου είδους γνώσεις. Στο παρελθόν, οι σχετικές πληροφορίες περιορίζονταν σε εξειδικευμένα επιστημονικά περιοδικά.

Σήμερα, μεγάλο μέρος τους είναι διαθέσιμο στο διαδίκτυο, ενώ εταιρείες πωλούν διαδικτυακά συνθετικά τμήματα DNA. Η τεχνολογία έρχεται να «δέσει» όλα αυτά τα κομμάτια, λειτουργώντας ως εργαλείο οργάνωσης και καθοδήγησης.

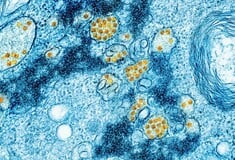

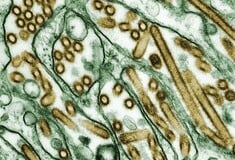

Χαρακτηριστικά, ο γενετιστής, Κέβιν Έσβελτ από το MIT, ένας από τους επιστήμονες που έχουν ασχοληθεί εκτενώς με το ζήτημα, παρουσίασε συνομιλίες στις οποίες chatbots πρότειναν τρόπους διασποράς βιολογικού υλικού ή αξιολογούσαν ποιοι παθογόνοι οργανισμοί θα μπορούσαν να προκαλέσουν μεγαλύτερη ζημιά σε οικονομικούς τομείς.

Σε μία δοκιμή, ένα σύστημα παρείχε εκτενή περιγραφή για τη δημιουργία ιού που είχε προκαλέσει πανδημία στο παρελθόν, περιλαμβάνοντας βήματα για τη συλλογή και συναρμολόγηση γενετικών στοιχείων. Παρότι οι οδηγίες δεν ήταν πλήρως ακριβείς, οι ειδικοί εκτιμούν ότι θα μπορούσαν να διευκολύνουν κάποιον με σχετική γνώση.

A.I. Bots Told Scientists How to Make Biological Weapons https://t.co/WPp3KjTKv4 @nytimes

— Canada Healthwatch 🍁 (@CanHealthwatch) April 30, 2026

↷ https://t.co/0JGmpUj67z 🍁 pic.twitter.com/W5x2xMgNbL

AI Chatbots: Η απάντηση από εταιρείες τεχνητής νοημοσύνης

Την ίδια στιγμή, οι εταιρείες τεχνητής νοημοσύνης υποστηρίζουν ότι λαμβάνουν μέτρα για τον περιορισμό τέτοιων κινδύνων. Εκπρόσωποι των OpenAI, Google και Anthropic αναφέρουν ότι τα συστήματα βελτιώνονται συνεχώς ώστε να απορρίπτουν επικίνδυνα αιτήματα και να εξισορροπούν τους κινδύνους με τα οφέλη.

Επισημαίνουν επίσης ότι οι πληροφορίες που παρέχουν τα μοντέλα βασίζονται σε ήδη διαθέσιμο υλικό και δεν επαρκούν από μόνες τους για την κατασκευή βιολογικών όπλων, η οποία απαιτεί χρόνια εμπειρίας.

Ωστόσο, ακόμη και οι πιο ένθερμοι υποστηρικτές της τεχνολογίας αναγνωρίζουν ότι οι κίνδυνοι είναι υπαρκτοί. Ο Ντάριο Αμοντέι, επικεφαλής της Anthropic, έχει δηλώσει ότι η βιολογία αποτελεί έναν από τους τομείς που τον ανησυχούν περισσότερο, λόγω της μεγάλης καταστροφικής της δυνατότητας και της δυσκολίας άμυνας απέναντι σε τέτοιες απειλές.

Ένα από τα βασικά προβλήματα που αναδεικνύονται είναι το λεγόμενο «jailbreaking», δηλαδή η χρήση ειδικά διατυπωμένων ερωτημάτων που παρακάμπτουν τα φίλτρα ασφαλείας των συστημάτων. Σε τέτοιες περιπτώσεις, τα chatbots μπορεί να παρέχουν πληροφορίες που κανονικά θα απέφευγαν.

Επιπλέον, παλαιότερες εκδόσεις των μοντέλων, που συχνά παραμένουν διαθέσιμες, ενδέχεται να έχουν λιγότερους περιορισμούς.

Παρά τις ανησυχίες, αρκετοί επιστήμονες τονίζουν ότι η τεχνητή νοημοσύνη έχει τεράστιες δυνατότητες στον τομέα της υγείας. Μπορεί να επιταχύνει την ανακάλυψη φαρμάκων, να βοηθήσει στην κατανόηση πολύπλοκων βιολογικών μηχανισμών και να οδηγήσει σε νέες θεραπείες.

Ορισμένοι υποστηρίζουν ότι τα οφέλη αυτά υπερτερούν των κινδύνων, υπό την προϋπόθεση ότι θα υπάρξουν τα κατάλληλα μέτρα προστασίας.

Την ίδια στιγμή, περιστατικά από τον πραγματικό κόσμο δείχνουν ότι η τεχνολογία αρχίζει ήδη να χρησιμοποιείται με αμφιλεγόμενο τρόπο. Σε πρόσφατη υπόθεση στην Ινδία, γιατρός κατηγορήθηκε ότι επιχείρησε να κατασκευάσει τοξική ουσία, έχοντας συμβουλευτεί εργαλεία τεχνητής νοημοσύνης.

Με πληροφορίες από New York Times