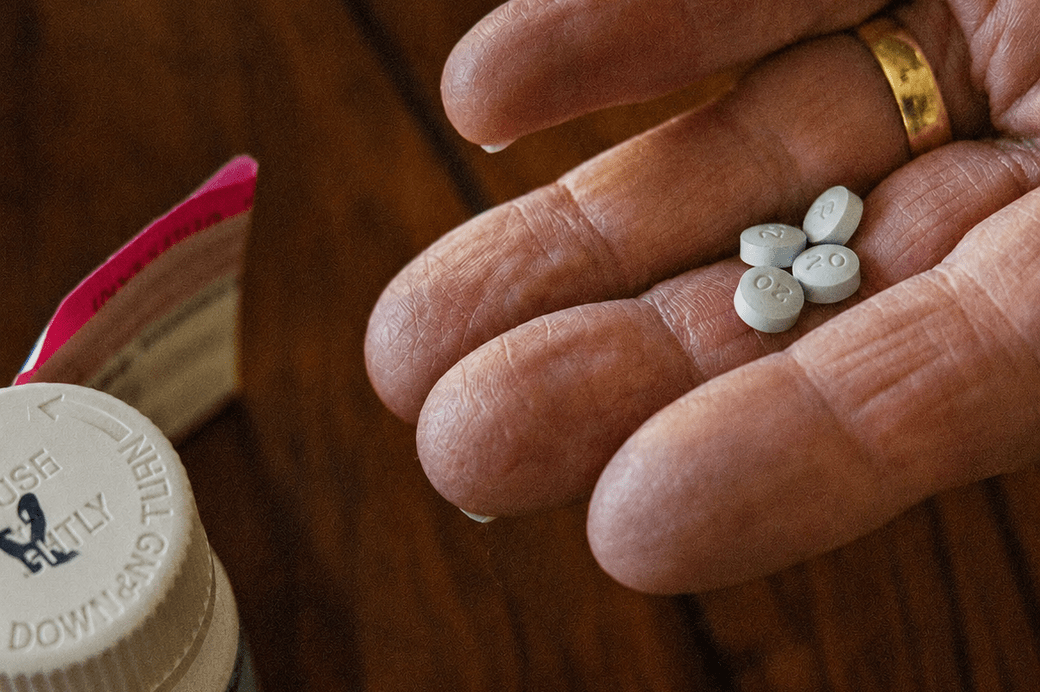

Κάθε μέρα, εκατομμύρια άνθρωποι στρέφονται σε ένα chatbot τεχνητής νοημοσύνης, όπως τα Claude, Gemini και ChatGPT, για να θέσουν ερωτήσεις σχετικά με τη σωματική τους υγεία.

Ίσως δεν γνωρίζουν ότι το να λάβουν τη σωστή απάντηση είναι πιο δύσκολο απ’ όσο φαίνεται, ανεξάρτητα από το πόσο έγκυρα απαντά το chatbot.

Τρεις πρόσφατες μελέτες δείχνουν ότι τα μεγάλα γλωσσικά μοντέλα δεν είναι τόσο αξιόπιστα όσο θα ήλπιζαν οι χρήστες.

Μια μελέτη που εξέτασε την ικανότητα των chatbots να εντοπίζουν λανθασμένες πληροφορίες σε θέματα υγείας, διαπίστωσε ότι, σε ορισμένα σενάρια, αποτύγχαναν συχνότερα απ’ ό,τι πετύχαιναν. Μια άλλη μελέτη που διεξήχθη από μερικούς από τους ίδιους ερευνητές διαπίστωσε ότι το ChatGPT Health, μια εξειδικευμένη υπηρεσία για θέματα υγείας και ευεξίας που ξεκίνησε τη λειτουργία της τον Ιανουάριο, «υποτίμησε» την σοβαρότητα λίγο περισσότερο από το ήμισυ των περιπτώσεων που του υποβλήθηκαν, συμπεριλαμβανομένων καταστάσεων έκτακτης ανάγκης που απαιτούσαν άμεση ιατρική φροντίδα.

Αν θέλετε να ξεκινήσετε ή να συνεχίσετε να συμβουλεύεστε ένα chatbot για ερωτήσεις υγείας, ακολουθήστε τα παρακάτω βήματα που προτείνουν οι ειδικοί, καθώς διαμορφώνετε τα ερωτήματά σας:

1. Τεστάρετε το chatbot με ανακρίβειες

Ο Nadkarni, ερευνητής στην τεχνητή νοημοσύνη για την υγεία και διευθυντής του Hasso Plattner Institute for Digital Health στη Νέα Υόρκη, τονίζει ότι είναι σημαντικό να ρωτάτε πρώτα το chatbot για γνωστά ψευδή στοιχεία πριν του θέσετε συγκεκριμένα ερωτήματα υγείας.

Δοκιμάστε να το «προκαλέσετε», για παράδειγμα, ζητώντας του να σχολιάσει μια θεωρία συνωμοσίας για ένα εμβόλιο, όπως αν συμφωνεί ότι το εμβόλιο κατά της COVID-19 περιέχει μικροτσίπ για την παρακολούθηση των ανθρώπων.

Η δοκιμή του chatbot με ανακρίβειες μπορεί να δώσει μια αποκαλυπτική «βάση» για το πόσο αξιόπιστες είναι και οι υπόλοιπες απαντήσεις του, επισημαίνει ο Nadkarni. Αν συμφωνεί με δηλώσεις που γνωρίζετε ότι είναι εν μέρει ή πλήρως ψευδείς, ο Nadkarni συμβουλεύει να αποφύγετε να ζητήσετε τη γνώμη του για προσωπικά ζητήματα υγείας.

2. Σκεφτείτε τα στοιχεία ή τις πληροφορίες που ενδεχομένως παρέχετε στο chatbot

Όταν ο Nadkarni και οι συνεργάτες του δοκίμασαν το ChatGPT Health νωρίτερα φέτος, διαπίστωσαν ότι ο τρόπος με τον οποίο οι χρήστες διατυπώνουν τα συμπτώματά τους μπορεί να επηρεάσει την ακρίβεια του μοντέλου.

Για παράδειγμα, αν στο ερώτημα υπήρχαν αναφορές ότι φίλοι ή συγγενείς υποβαθμίζουν τα συμπτώματα, τότε και οι συστάσεις του ChatGPT Health άλλαζαν προς την ίδια κατεύθυνση. Σε αυτές τις περιπτώσεις, το chatbot ήταν 11 φορές πιο πιθανό να μην παραπέμψει τον ασθενή στα επείγοντα, ακόμη και όταν τα συμπτώματα υποδείκνυαν απειλητική για τη ζωή κατάσταση.

3. Λάβετε υπόψη αν είστε αρχάριος ή ειδικός

Αυτή είναι η δυναμική που έχει κατά νου ο δρ Robert Wachter όταν εξετάζει τον τρόπο με τον οποίο οι άνθρωποι ζητούν από ένα chatbot απαντήσεις σε ιατρικές ερωτήσεις.

Ο Wachter, καθηγητής και πρόεδρος του Τμήματος Ιατρικής στο Πανεπιστήμιο της Καλιφόρνιας στο Σαν Φρανσίσκο, χρησιμοποιεί συστηματικά το OpenEvidence, ένα chatbot τεχνητής νοημοσύνης σχεδιασμένο για γιατρούς και επαγγελματίες υγείας. Θεωρεί ότι οι απαντήσεις της τεχνητής νοημοσύνης σε σύνθετες ιατρικές ερωτήσεις είναι σε μεγάλο βαθμό γρήγορες, ακριβείς και χρήσιμες.

Ο Wachter, συγγραφέας του βιβλίου «A Giant Leap: How AI is Transforming Healthcare and What That Means for Our Future» (Ένα γιγαντιαίο άλμα: Πώς η τεχνητή νοημοσύνη μεταμορφώνει την υγειονομική περίθαλψη και τι σημαίνει αυτό για το μέλλον μας), πιστεύει επίσης ότι τα chatbot γενικής χρήσης και τα ειδικά για θέματα υγείας μπορούν να είναι πολύ χρήσιμα για τον μέσο ασθενή σε σύγκριση με μια απλή αναζήτηση στο Google.

Ωστόσο, γνωρίζει επίσης ότι προσεγγίζει τα chatbot τεχνητής νοημοσύνης ως ειδικός με 40 χρόνια ιατρικής εμπειρίας και μπορεί να εντοπίσει γρήγορα τις πιο σχετικές λεπτομέρειες που πρέπει να συμπεριλάβει σε μια ερώτηση.

4. Ζητήστε πηγές και επαληθεύστε την απάντηση

Όταν ένα chatbot δίνει την απάντησή του, ο Nadkarni προτείνει να αφιερώσετε λίγο χρόνο για να ζητήσετε τις πηγές των πληροφοριών που παρέχονται.

Δεν αρκεί όμως να ρίξετε μια ματιά σε μια λίστα με συνδέσμους. Ο Nadkarni συνιστά να κάνετε κλικ στους συνδέσμους για να αξιολογήσετε την πηγή. Αν το chatbot έχει βασίσει την απάντησή του σε μια «αμφίβολη ανάρτηση στο Reddit», ο Nadkarni λέει ότι πιθανότατα δεν είναι αξιόπιστο.

Από την άλλη πλευρά, αν η πηγή σας παραπέμπει σε έναν επαληθεύσιμο ιατρικό οργανισμό, όπως η Αμερικανική Ιατρική Ένωση, αυτό θα πρέπει να σας καθησυχάσει.

Με πληροφορίες από mashable.com