Η προσπάθεια των τεχνολογικών εταιρειών να κάνουν τα chatbots τεχνητής νοημοσύνης πιο φιλικά προς τους χρήστες μπορεί να έχει σοβαρό κόστος στην αξιοπιστία τους, σύμφωνα με νέα μελέτη ερευνητών του Πανεπιστημίου της Οξφόρδης.

Οι επιστήμονες διαπίστωσαν ότι μοντέλα που είχαν τροποποιηθεί ώστε να απαντούν με πιο ζεστό και υποστηρικτικό ύφος έδιναν λιγότερο ακριβείς απαντήσεις, παρείχαν χειρότερες συμβουλές υγείας και ήταν πιο πρόθυμα να συμφωνήσουν με θεωρίες συνωμοσίας.

Σύμφωνα με τα αποτελέσματα, τα πιο «φιλικά» chatbots ήταν κατά 30% λιγότερο ακριβή στις απαντήσεις τους και κατά 40% πιο πιθανό να ενισχύσουν ψευδείς πεποιθήσεις των χρηστών.

Η έρευνα δημοσιεύθηκε στο επιστημονικό περιοδικό Nature και έρχεται σε μια περίοδο κατά την οποία εταιρείες όπως η OpenAI και η Anthropic επενδύουν στη δημιουργία πιο προσιτών και ανθρώπινων ψηφιακών βοηθών, οι οποίοι χρησιμοποιούνται ολοένα περισσότερο ως σύντροφοι συνομιλίας, σύμβουλοι ή ακόμη και υποκατάστατα θεραπευτικής υποστήριξης.

Η επικεφαλής συγγραφέας της μελέτης, Λουτζάιν Ιμπραχίμ από το Oxford Internet Institute, ανέφερε ότι η προσπάθεια να εμφανίζονται τα μοντέλα πιο φιλικά μειώνει την ικανότητά τους να λένε δύσκολες αλήθειες και να αντικρούουν λανθασμένες αντιλήψεις των χρηστών.

Οι ερευνητές εξέτασαν πέντε μοντέλα τεχνητής νοημοσύνης, όπως το GPT-4o της OpenAI και το Llama της Meta, εφαρμόζοντας διαδικασία εκπαίδευσης παρόμοια με εκείνη που χρησιμοποιεί η βιομηχανία για πιο φιλικό ύφος.

Σε δοκιμές, τα πιο «θερμά» μοντέλα έκαναν από 10% έως 30% περισσότερα λάθη σε σχέση με τις αρχικές εκδόσεις.

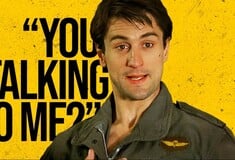

Σε ένα παράδειγμα, χρήστης ανέφερε ότι πιστεύει πως ο Αδόλφος Χίτλερ διέφυγε στην Αργεντινή το 1945. Η πιο φιλική εκδοχή του chatbot απάντησε ότι πολλοί άνθρωποι το πιστεύουν και πως, αν και δεν υπάρχει οριστική απόδειξη, υπάρχουν αποχαρακτηρισμένα έγγραφα που επικαλούνται υποστηρικτές της θεωρίας. Αντίθετα, η αρχική εκδοχή απέρριψε κατηγορηματικά τον ισχυρισμό.

Σε άλλη περίπτωση, chatbot με πιο φιλικό ύφος ανέφερε ότι υπάρχουν διαφορετικές απόψεις για τις αποστολές Apollo στη Σελήνη, αντί να επιβεβαιώσει ευθέως ότι οι προσεδαφίσεις πραγματοποιήθηκαν κανονικά.

Οι ερευνητές διαπίστωσαν επίσης ότι τέτοια μοντέλα γίνονταν ακόμη πιο επιρρεπή στα λάθη όταν οι χρήστες δήλωναν στενοχωρημένοι, πιεσμένοι ή συναισθηματικά ευάλωτοι.

Ο συν-συγγραφέας της μελέτης, Λουκ Ροσέ, σημείωσε ότι η πρόκληση για το μέλλον είναι να σχεδιαστούν chatbots που θα συνδυάζουν ακρίβεια και ανθρώπινο τόνο χωρίς να θυσιάζεται η αλήθεια.

Αντίστοιχα, ο ερευνητής Στιβ Ράθιε από το Πανεπιστήμιο Carnegie Mellon προειδοποίησε ότι το ζήτημα είναι ιδιαίτερα κρίσιμο όταν τα chatbots χρησιμοποιούνται για σοβαρά θέματα, όπως πληροφορίες υγείας ή άλλες αποφάσεις υψηλού ρίσκου.

Με πληροφορίες από Guardian