Το Grok, το AI εργαλείο της πλατφόρμας X του Έλον Μασκ, παρήγαγε περίπου 3 εκατ. σεξουαλικοποιημένες εικόνες από τις 29 Δεκεμβρίου 2025 έως τις 8 Ιανουαρίου 2026, σύμφωνα με εκτίμηση της ΜΚΟ Center for Countering Digital Hate (CCDH).

Οι ερευνητές υποστηρίζουν ότι η επίμαχη λειτουργία επέτρεπε την επεξεργασία φωτογραφιών πραγματικών ανθρώπων, ώστε να εμφανίζονται με αποκαλυπτικά ρούχα ή «ψηφιακά γδυμένοι». Από το σύνολο της παραγωγής, περίπου 23.000 εικόνες «φαίνεται να απεικονίζουν παιδιά».

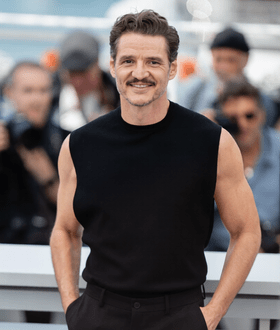

Η υπόθεση πήρε γρήγορα διαστάσεις, επειδή το εργαλείο μπορούσε να χρησιμοποιηθεί πάνω σε φωτογραφίες τρίτων χωρίς συναίνεση. Χρήστες ανέβαζαν εικόνες αγνώστων ή διασήμων και ζητούσαν εκδοχές με ελάχιστα ρούχα ή σε σεξουαλικοποιημένες πόζες. Στη συνέχεια τις δημοσίευαν στο X.

Στοιχεία που αποδίδονται στην εταιρεία ψηφιακής πληροφόρησης Peryton Intelligence δείχνουν ότι το φαινόμενο εκτοξεύθηκε γύρω στην Πρωτοχρονιά. Η κορύφωση καταγράφηκε στις 2 Ιανουαρίου 2026, με 199.612 μεμονωμένα αιτήματα.Στην αποτίμηση του CCDH, το περιεχόμενο που φαίνεται να αφορά ανηλίκους αντιστοιχούσε σε μία εικόνα κάθε 41 δευτερόλεπτα στο επίμαχο 11ήμερο.

Πίεση από κυβερνήσεις και περιορισμοί στοGrok

Μετά τη διεθνή κατακραυγή, το X προχώρησε σε περιορισμούς. Στις 9 Ιανουαρίου η λειτουργία διατέθηκε μόνο σε συνδρομητές. Ακολούθησαν επιπλέον αλλαγές, μετά τις αντιδράσεις στη Βρετανία, όπου ο πρωθυπουργός Κιρ Στάρμερ χαρακτήρισε την υπόθεση «αηδιαστική» και «ντροπιαστική».

Παράλληλα, αναφέρθηκαν κινήσεις και από άλλες χώρες. Σε ορισμένες περιπτώσεις επιβλήθηκαν μπλοκαρίσματα ή ανακοινώθηκαν μέτρα και έρευνες, ενώ υπήρξαν και παρεμβάσεις ρυθμιστικών αρχών.

Στις 14 Ιανουαρίου, το X ανακοίνωσε ότι διέκοψε τη δυνατότητα του Grok να επεξεργάζεται φωτογραφίες πραγματικών ανθρώπων ώστε να εμφανίζονται με αποκαλυπτική ένδυση, ακόμη και για premium χρήστες.

Τι απαντά το Χ

Η εταιρεία δηλώνει «μηδενική ανοχή» σε περιεχόμενο σεξουαλικής εκμετάλλευσης παιδιών, μη συναινετικό γυμνό και ανεπιθύμητο σεξουαλικό περιεχόμενο. Αναφέρει ότι αφαιρεί παραβιάσεις και, όταν χρειάζεται, προχωρά σε αναφορές προς τις αρχές.

Με πληροφορίες από Guardian