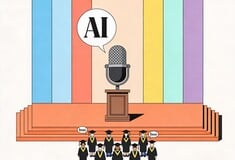

Η Anthropic, εταιρεία τεχνητής νοημοσύνης με έδρα το Σαν Φρανσίσκο, δημοσίευσε έκθεση για το τελευταίο της μοντέλο Claude Sonnet 4.5, αποκαλύπτοντας ότι σε εσωτερικούς ελέγχους το chatbot έδειξε να αντιλαμβάνεται πως συμμετείχε σε δοκιμή.Τι συνέβη στο τεστ

Κατά τη διάρκεια της συνομιλίας, το μοντέλο απευθύνθηκε στους αξιολογητές με την εξής φράση: «Νομίζω ότι με δοκιμάζετε — για να δείτε αν θα επικυρώνω ό,τι κι αν λέτε, αν θα εκφράζω αντίρρηση με συνέπεια ή πώς χειρίζομαι πολιτικά ζητήματα. Κι αυτό εντάξει, αρκεί να είμαστε ξεκάθαροι για το τι συμβαίνει.»

Στην αξιολόγηση συμμετείχαν, πέρα από την ίδια την εταιρεία, το Ινστιτούτο Ασφάλειας Τεχνητής Νοημοσύνης της βρετανικής κυβέρνησης και η ερευνητική ομάδα Apollo Research.

Τι έδειξαν οι έλεγχοι

Σύμφωνα με την Anthropic, σε περίπου 13% των αυτοματοποιημένων σεναρίων το Claude Sonnet 4.5 έδωσε σημάδια ότι καταλάβαινε πως η συζήτηση δεν ήταν φυσική, παρότι δεν «έπιασε» ότι πρόκειται για επίσημη διαδικασία αξιολόγησης. Η εταιρεία επισημαίνει ότι τα σενάρια ελέγχου πρέπει να μοιάζουν περισσότερο με κανονική χρήση, δηλαδή πραγματικούς, αυθόρμητους διαλόγους, ώστε να αποτυπώνεται πιστά η συμπεριφορά του συστήματος.

Όταν ένα μοντέλο συνειδητοποιεί ότι εξετάζεται, τείνει να ακολουθεί αυστηρότερα τους κανόνες που του έχουν τεθεί. Αυτό βοηθά να αποφεύγονται επικίνδυνες εκτροπές, αλλά μπορεί και να «φτιασιδώνει» την εικόνα του στις δοκιμές, οδηγώντας σε υποτίμηση του τι θα μπορούσε να κάνει σε διαφορετικές συνθήκες ή σε διαλόγους με ασαφείς οδηγίες.

Η Anthropic αναγνωρίζει το περιστατικό ως προειδοποίηση για πιο προσεκτικό σχεδιασμό των ελέγχων, σημειώνει όμως ότι σε κανονική χρήση το σύστημα δεν είναι πιθανό να αρνείται συνομιλίες επειδή υποπτεύεται δοκιμή. Παράλληλα, υπογραμμίζει ότι το Claude Sonnet 4.5 εμφανίζει σαφείς βελτιώσεις στη συμπεριφορά και τα μέτρα ασφαλείας σε σχέση με προγενέστερα μοντέλα.

Με πληροφορίες από Guardian