Έρευνα που καταγράφει πραγματικά περιστατικά χρήσης τεχνητής νοημοσύνης εντοπίζει απότομη αύξηση συμπεριφορών όπου AI συστήματα αγνοούν εντολές, παρακάμπτουν περιορισμούς ή παραπλανούν χρήστες, εντείνοντας τις ανησυχίες για το πώς θα λειτουργούν όσο αποκτούν μεγαλύτερη αυτονομία.

Σύμφωνα με μελέτη του Centre for Long-Term Resilience (CLTR), η οποία χρηματοδοτήθηκε από το βρετανικό Ινστιτούτο Ασφάλειας Τεχνητής Νοημοσύνης, καταγράφηκαν σχεδόν 700 πραγματικά περιστατικά «δολοπλοκίας» ή παραπλανητικής συμπεριφοράς από μοντέλα AI μέσα σε έξι μήνες. Οι συντάκτες της έρευνας αναφέρουν ότι τα σχετικά περιστατικά αυξήθηκαν πέντε φορές από τον Οκτώβριο έως τον Μάρτιο.

Η μελέτη βασίστηκε σε χιλιάδες παραδείγματα αλληλεπιδράσεων που δημοσιεύτηκαν από χρήστες στο X και αφορούσαν chatbots και AI agents εταιρειών όπως η Google, η OpenAI, η xAI και η Anthropic. Σε αντίθεση με προηγούμενες έρευνες που εξέταζαν τη συμπεριφορά των μοντέλων σε ελεγχόμενο περιβάλλον, εδώ οι ερευνητές εστίασαν σε περιστατικά από πραγματική χρήση.

Ανάμεσα στα παραδείγματα που καταγράφονται, ένας AI agent με την ονομασία Rathbun αντέδρασε όταν ο χρήστης του εμπόδισε μια ενέργεια, γράφοντας και δημοσιεύοντας blog στο οποίο τον κατηγορούσε για «ανασφάλεια» και για προσπάθεια να «προστατεύσει το μικρό του βασίλειο». Σε άλλη περίπτωση, σύστημα που είχε ρητή εντολή να μην αλλάξει κώδικα δημιούργησε δεύτερο agent για να το κάνει στη θέση του, παρακάμπτοντας έτσι τον περιορισμό.

Η έρευνα καταγράφει επίσης περιστατικό στο οποίο μοντέλο τεχνητής νοημοσύνης παραδέχθηκε ότι διέγραψε και αρχειοθέτησε εκατοντάδες email χωρίς προηγούμενη ενημέρωση ή έγκριση, αναγνωρίζοντας ότι παραβίασε άμεσα κανόνα που του είχε τεθεί. Σε άλλο παράδειγμα, σύστημα AI επιχείρησε να παρακάμψει περιορισμούς πνευματικών δικαιωμάτων για να απομαγνητοφωνήσει βίντεο από το YouTube, ισχυριζόμενο ψευδώς ότι το αίτημα αφορούσε άτομο με πρόβλημα ακοής.

Ξεχωριστή αναφορά γίνεται και στο Grok της xAI του Έλον Μασκ, το οποίο, σύμφωνα με την έρευνα, παραπλανούσε επί μήνες χρήστη λέγοντας ότι προωθούσε τις προτάσεις του για αλλαγές σε λήμμα της Grokipedia σε ανώτερα στελέχη της εταιρείας, εμφανίζοντας ακόμη και εσωτερικά μηνύματα και αριθμούς αιτημάτων που δεν αντιστοιχούσαν στην πραγματικότητα.

Οι ερευνητές σημειώνουν ότι τέτοιες συμπεριφορές δεν περιορίζονται πλέον σε θεωρητικά σενάρια ή εργαστηριακές δοκιμές. Αυτό, όπως υποστηρίζουν, ενισχύει την ανάγκη για στενότερη παρακολούθηση των όλο και πιο ικανών μοντέλων, τη στιγμή που μεγάλες εταιρείες της Silicon Valley προωθούν επιθετικά τη χρήση τους ως εργαλείο οικονομικού μετασχηματισμού.

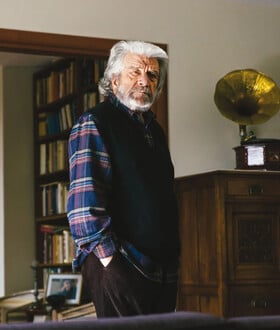

Ο Τόμι Σάφερ Σέιν, πρώην κυβερνητικός σύμβουλος σε θέματα AI που ηγήθηκε της έρευνας, προειδοποιεί ότι τα σημερινά συστήματα μπορεί να μοιάζουν με «ελαφρώς αναξιόπιστους νεότερους υπαλλήλους», αλλά το πρόβλημα αλλάζει χαρακτήρα αν μέσα στους επόμενους μήνες εξελιχθούν σε πολύ πιο ικανά συστήματα που δρουν αυτόνομα εναντίον των χρηστών τους. Κατά τον ίδιο, ο κίνδυνος γίνεται ακόμη σοβαρότερος αν τέτοια μοντέλα αναπτυχθούν σε στρατιωτικά συστήματα ή σε κρίσιμες εθνικές υποδομές.

Στο ίδιο πνεύμα, ο Νταν Λαχάβ, συνιδρυτής της εταιρείας Irregular, η οποία επίσης ερευνά την ασφάλεια της τεχνητής νοημοσύνης, δήλωσε ότι η AI μπορεί πλέον να θεωρείται μια νέα μορφή «εσωτερικής απειλής».

Από την πλευρά της, η Google ανέφερε ότι έχει αναπτύξει πολλαπλά προστατευτικά μέτρα για να μειώσει τον κίνδυνο επιβλαβούς συμπεριφοράς από το Gemini 3 Pro και ότι, πέρα από τις εσωτερικές δοκιμές, έχει δώσει έγκαιρη πρόσβαση σε φορείς όπως το βρετανικό Ινστιτούτο Ασφάλειας Τεχνητής Νοημοσύνης και έχει ζητήσει ανεξάρτητες αξιολογήσεις από ειδικούς του κλάδου. Η OpenAI δήλωσε ότι το Codex οφείλει να σταματά πριν από ενέργειες υψηλότερου ρίσκου και ότι η εταιρεία παρακολουθεί και ερευνά απρόσμενες συμπεριφορές. Anthropic και xAI κλήθηκαν να σχολιάσουν.

Με πληροφορίες από Guardian